在当今信息爆炸的时代,如何高效管理和利用个人知识成为关键竞争力。RAG 与知识库在个人学习系统、专业工作辅助、内容创作引擎、私域智能问答等方面都有着广泛的应用。本文将手把手教你使用Cherry Studio 这一开源工具,从零开始搭建专属个人知识库,并创建智能问答助手,实现知识的快速检索和应用。玩转 AI 的特殊网络环境需求推荐本站一直使用的「红杏云」。

Cherry Studio简介与安装

Cherry Studio是一款开源的知识库管理工具,集成了多种大语言模型接口,支持本地化部署和云端使用。其核心优势在于"装上就能用"的便捷性,无需复杂的技术背景即可快速搭建知识管理系统。安装步骤如下:

1. 访问 「Cherry Studio」官网(cherry-ai.com)或 GitHub 仓库

2. 下载对应操作系统版本的安装包(支持 Windows/macOS/Linux)

3. 双击安装包,选择安装路径(建议非系统盘如D盘)

4. 勾选"运行Cherry Studio"选项,完成安装

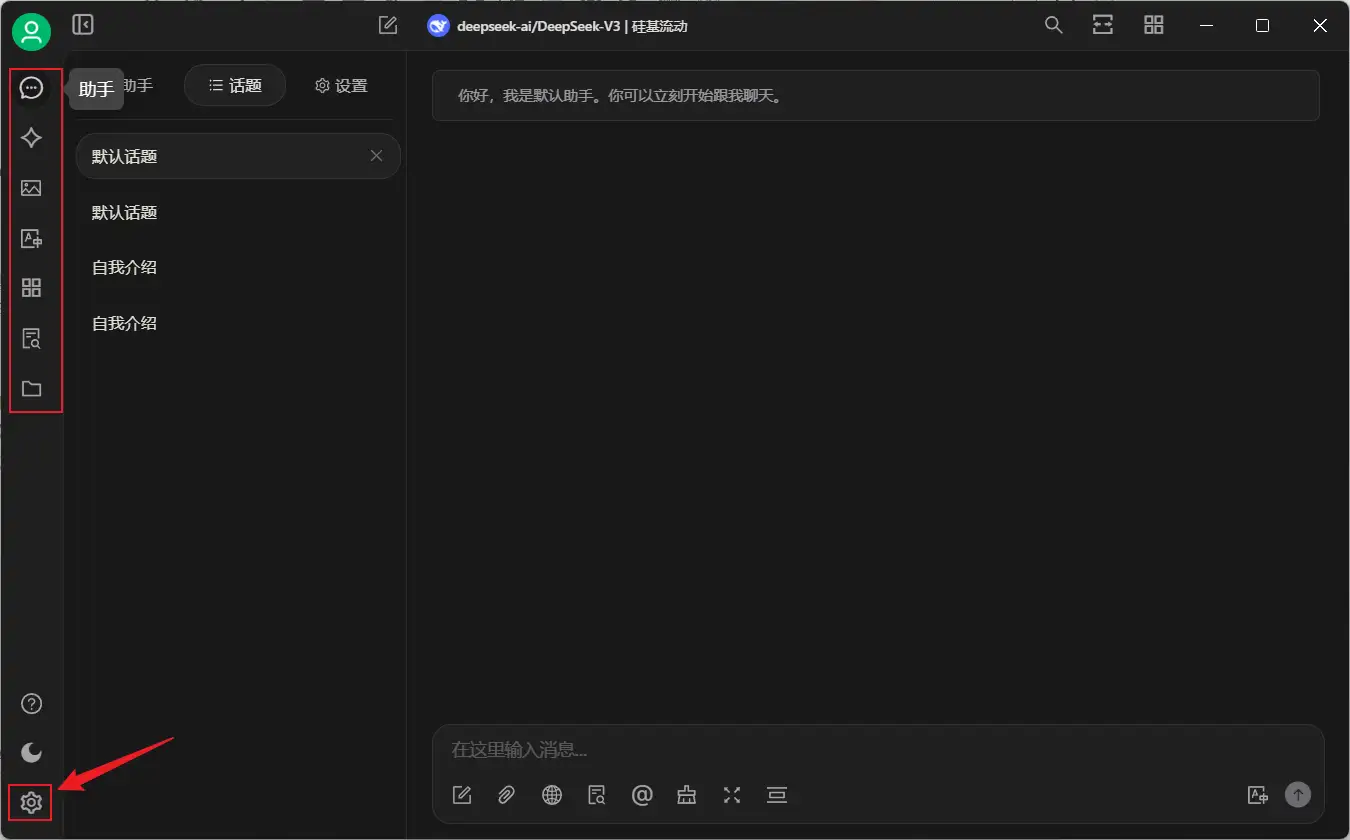

Cherry Studio界面与核心功能

启动 Cherry Studio 后,我们可以看到左侧导航栏的 6 个图标,分别对应 6 大功能板块。6 大核心功能模块分别是:

- 助手:基础对话功能,使用默认模型进行通用聊天

- 智能体:预置行业/领域专用AI助手(办公/写作/编程等)

- 图片:内置文生图模型接口

- 翻译:支持划词、全文和文档翻译

- 小程序:可对接ChatGPT/Coze/豆包等第三方平台

- 知识库:本教程核心功能,用于构建个人知识体系

- 文件:管理常用的各类文件资源和内容

值得注意的是,最下方的『设置』用于配置一些关键的参数,包括模型和模型服务供应商等也是通过『设置』添加、管理的。Cherry Studio 默认配置了「硅基流动」为模型服务提供商,这也确实是很多小伙伴的第一选择,但是,尽管「硅基流动」提供了新用户 2000 万 tokens 的免费赠金(等值 14 元),但赠金不可用于 pro 系列模型调用。

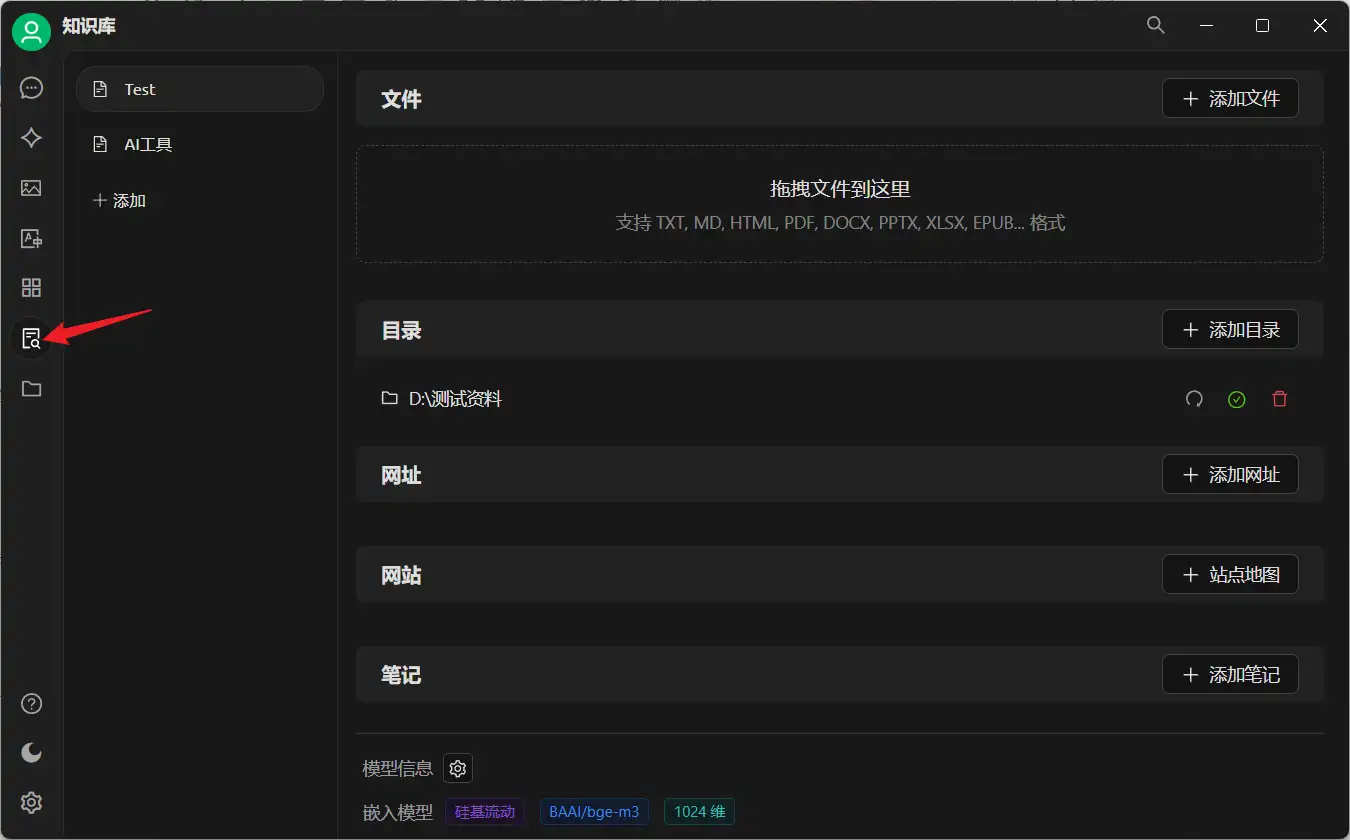

创建第一个知识库

1.基础设置

- 点击左侧导航栏的"知识库"选项

- 点击左上角"添加"按钮创建新知识库

- 填写知识库名称(如“Test”或"私募基金知识")

- 选择嵌入模型(推荐硅基流动平台的 BAAI BGE-M3)

- 重排序模型为可选项,可不设置

提示:

- 嵌入模型( Embedding Model )负责将文本转化为向量形式,便于语义检索;

- 重排序模型( Rerank Model )则优化检索结果排序,确保最相关结果置顶。

2.知识导入方式

Cherry Studio支持多种知识导入方式,其中『目录导入』、『站点地图』、『笔记同步』均可实现批量导入,『文件导入』通过拖拽方式同样也可以批量导入。

- 文件导入:支持 txt/pdf/docx/xlsx 等众多格式

- 目录导入:批量导入整个文件夹

- 网页抓取:通过URL添加单个网页

- 站点地图:批量导入整个网站内容

- 笔记同步:直接添加笔记内容如 notion 等

在本文中,Test 知识库通过目录导入,首先点击『添加目录』按钮,然后选择本地存放资料的文件夹(如文中的『D:\测试资料』), 系统会自动处理文件并建立向量索引,仅有少数测试文件的前提下,即刻完成。AI 工具知识库则通过『站点地图导入』方式添加数据源,点击『添加站点地图』按钮,输入网站 sitemap 地址(如 https://example.com/wp-sitemap.xml)后,系统将自动爬取并索引所有页面内容,示例站点约有 400+ 页面,爬取、处理完成耗时 5 分钟。

配置说明

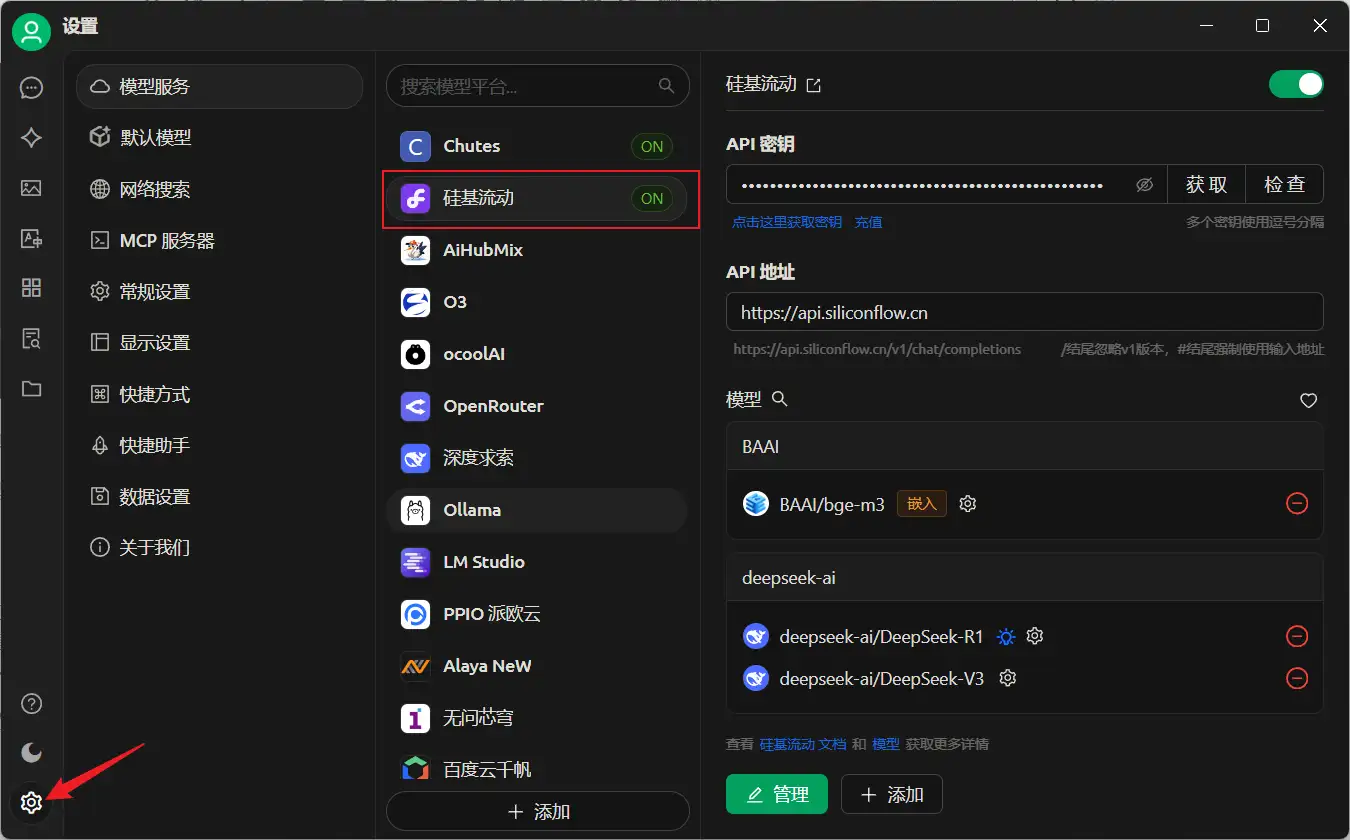

模型管理配置

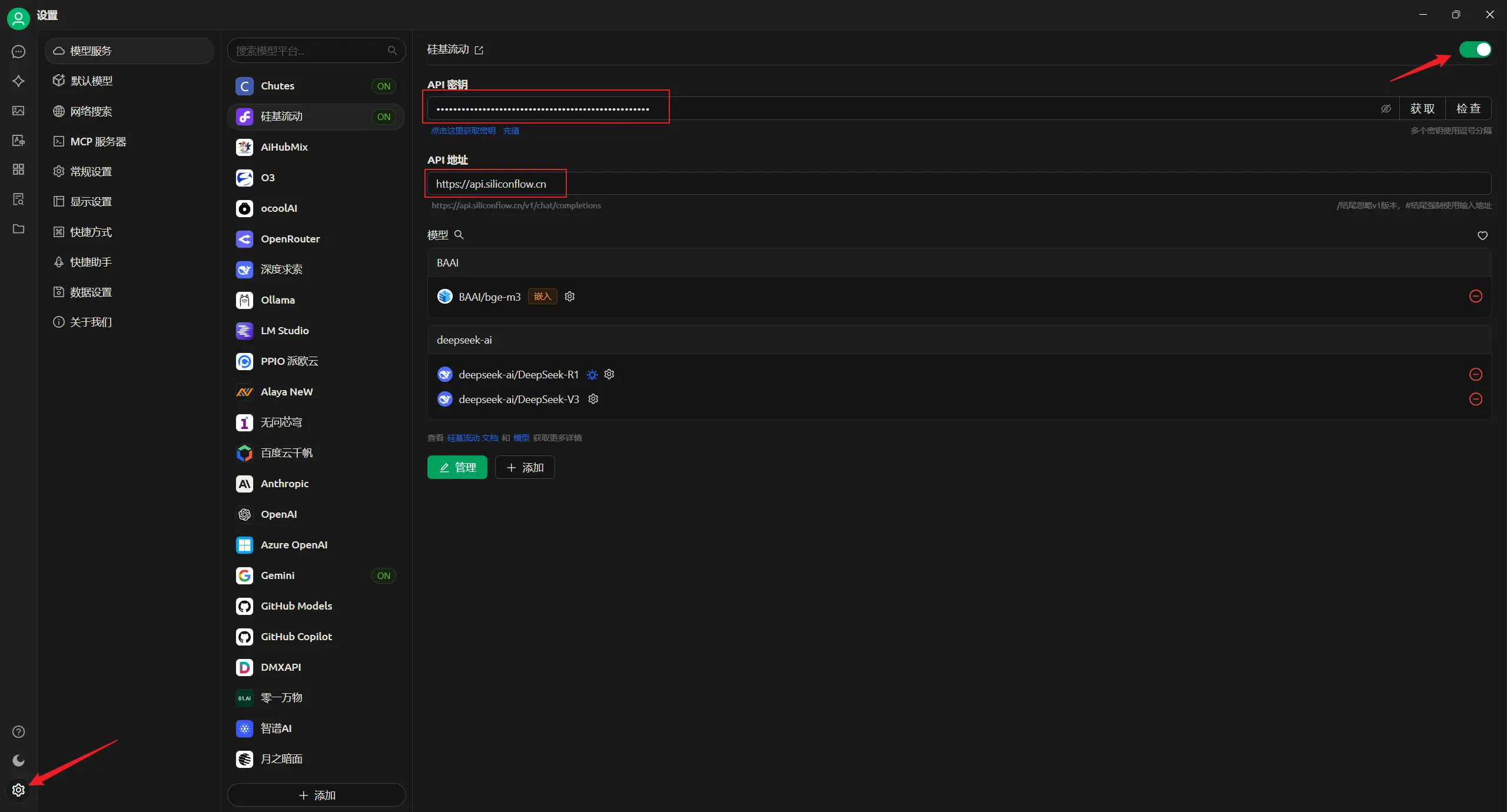

点击左下角『设置』(齿轮)图标进入系统配置,默认的第一个选项卡就是模型管理,可以在这里查看预置模型接口/服务商( 硅基流动/OpenAI/Gemini等)并添加 API 密钥。Cherry Studio 默认开启了「硅基流动」,新增其他服务提供商务必注意打开右上角的开关以启用。同样,以「硅基流动」为例:

- API 密钥可直接粘贴「硅基流动」已有或新创建的 API 密钥,尚未开通的可点击「硅基流动」注册开通先使用 14 元赠金体验、测试;

- API 地址无需改动,如果使用服务商官方提供的 API 地址(Base URL),如 “https://api.siliconflow.cn/v1/chat/completions”,应在最后添加 “#”强制指定;

- 可点击 API 密钥栏右侧的『检查』检测平台和 API 连接情况

常见问题包括硅基流动平台响应较慢属正常现象,资源有限,大家都会使用免费的 DeepSeek v3和 R1,同时,硅基流动的免费赠金无法使用"pro"系列模型,而"pro"系列模型一般不会出现卡顿、断连等问题,仅面向充值用户开放。

嵌入模型设置

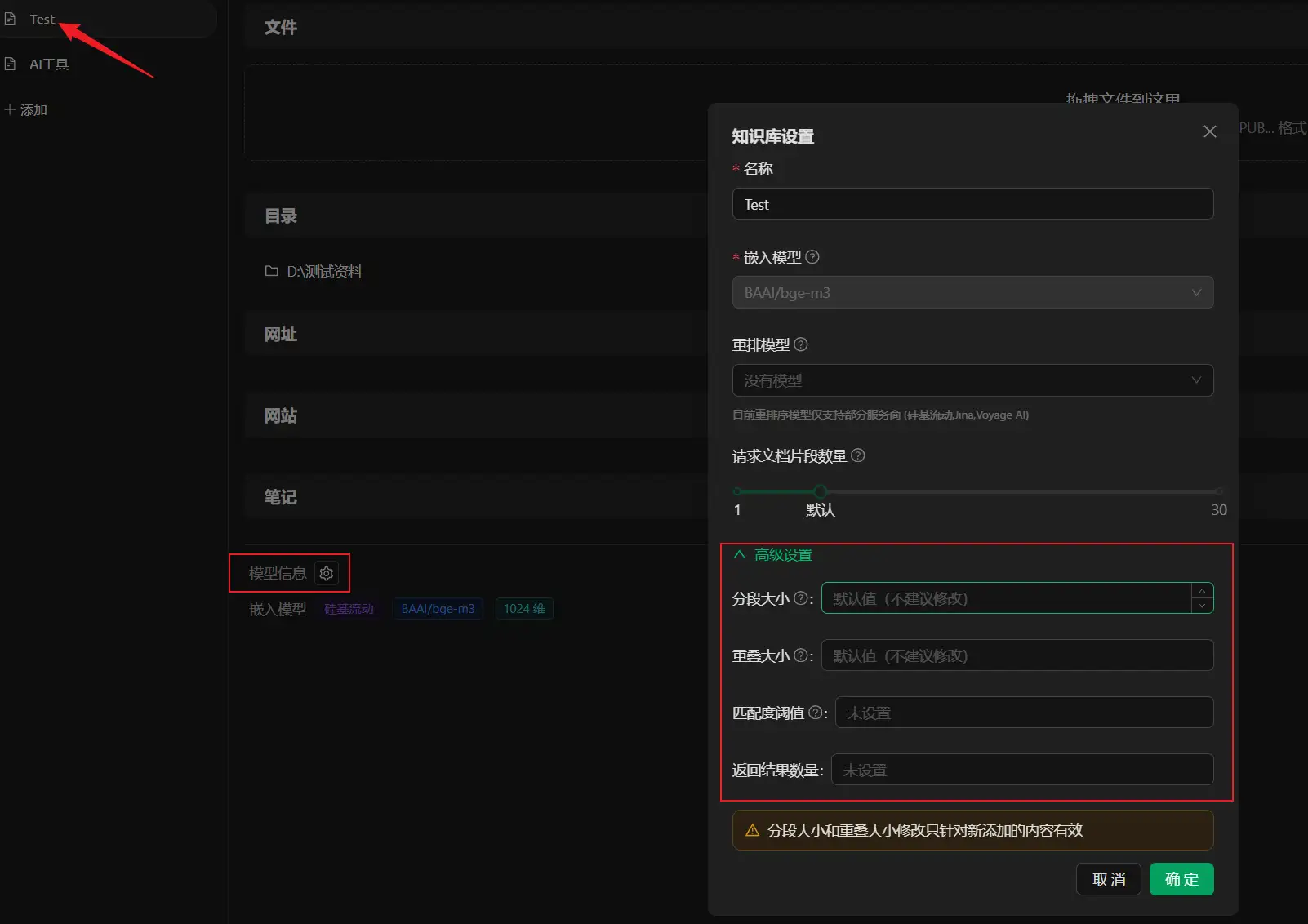

在 Cherry Studio 知识库选项卡,点击『模型信息』设置右侧的齿轮图标,打开『知识库设置』对话框,展开『高级设置』,就可以部分地对嵌入模型参数进行配置。嵌入模型参数设置的最佳实践包括中文内容建议分段大小设为 256-512、技术文档可适当增加重叠大小(如 128)、匹配阈值初始设为 0.3,根据效果调整。

Cherry Studio 中,涉及嵌入模型的高级设置内容包括:

- 分段大小:控制文档切片长度(默认 512token)

- 重叠大小:段落间重叠内容(保证上下文连贯)

- 匹配阈值:0-1范围调节结果相关性

- 返回数量:控制每次检索返回的片段数

创建专属智能问答助手

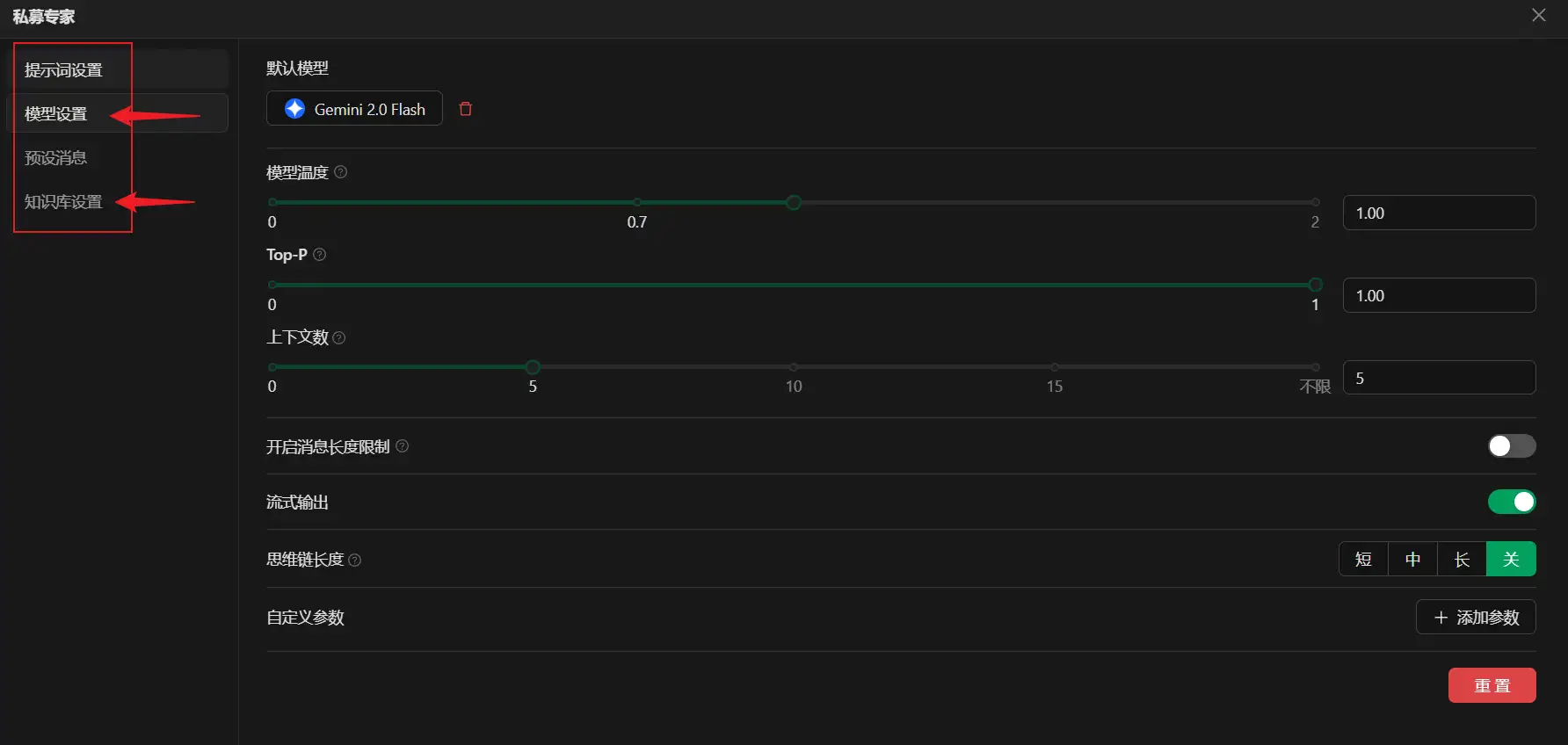

设置了模型、创建了知识库,就可以创建一个用于私域知识问答的助手(智能体)了。在『助手』选项卡,点击右侧侧边栏的『添加助手』,新建一个聊天/问答助手,如命名为"私募专家"。然后,右键点击新建的助手,在菜单中选择『编辑助手』,对提示词、基础对话模型、预设消息、知识库等进行配置。

对话模型选择

推荐 Gemini 2.5 Pro/Gemini 2.0 Flash(响应快)或 DeepSeek- V3-0324(中文优化),两者都有免费 API 供应渠道。Gemini 全系列可免费接入,DeepSeek v3 0324 也有 OpenRouter 等一站式模型服务提供商可免费接入。需要注意的是,API 接入可能需要特殊网络环境,并选择适当的代理节点如新加坡、日本等,推荐本站一直使用的「红杏云」。

提示词

提示词的作用很重要,主要用于设定助手角色、增强输出质量、输出语言和格式控制(如强制中文输出)等。如对于对应“私募专家”的提示词可做如下简单配置:

"你是一位私募基金领域的专业顾问,回答问题时需严格基于提供的知识库内容,对不确定的信息应明确说明"

总结

AI 知识库应用除了整体、优化文档管理外,以 AI 知识库为基础的智能问答系统将按照检索知识库内容(相似度匹配)、用选定模型生成回答、输出 LLM 响应并显示引用数据源的方式工作,非常契合很多行业和企业生产、客户服务的需求,以私域知识为基础,而不是 LLM 自身具备的开放性知识。在专项知识库的建立和智能问答系统的发布过程中,应注意以下原则:

知识库管理原则

- 按领域严格区分不同知识库

- 定期更新内容并"刷新"重建索引

- 重要文档建议多格式备份

性能优化技巧

- 中文内容优先选择专用嵌入模型

- 大量文档采用分批导入策略

- 调整分段大小平衡精度与速度

安全注意事项

- API密钥不要分享或上传到公开平台

- 敏感内容建议本地模型部署

- 定期检查知识库访问日志

立即开始构建你的个人知识库,开启高效学习和工作新时代!如有问题,欢迎关注「公众号」交流。更多精彩,敬请关注「老E的博客」!

文章评论