对于新手而言,在很多库Colab已经自带的情况下,Colab的应用实际就是Jupyter Notebook的使用。同时,Google Colab除了提供免费的GPU,还有很重要的一点是计算环境的预置,这会节省大量的时间,将重心放在代码和任务上。如果不使用Colab而是在本地安装配置相应的训练、推理环境,可能还需要进一步在WebUI方面进行搭建,对于尝鲜者或者轻度使用者而言,会选择放弃自行安装部署。

1.Whisper简介

Open AI于2022年9月21日开源了号称其英文语音识别能力已达到人类水准的Whisper神经网络,且它也支持其它98种语言的自动语音识别。 Whisper系统所提供的自动语音识别(Automatic Speech Recognition,ASR)模型是被训练来运行语音识别与翻译任务的,它们能将各种语言的语音变成文本,也能将这些文本翻译成英文。Whisper由python实现,同时拥有丰富的社区支持。

Whisper的核心功能语音识别,典型的日常应用场景包括:

- 可以帮助我们快捷将会议、讲座、课堂录音整理成文字稿;

- 可以为无字幕的资源自动生成字幕,无需等待各大字幕组的字幕资源;

- 可以使用whisper翻译发音练习录音,可以很好的应用于口语学习。

当然,最重要的是,OpenAI Whisper开源且免费。模型方面,有五种不同大小的模型可供选择,其中除了large模型外还提供了只支持英文的版本。模型越小占用显存越少,速度也更快,但精度也更低。

| Size | Parameters | English-only model | Multilingual model | Required VRAM | Relative speed |

|---|---|---|---|---|---|

| tiny | 39 M | tiny.en | tiny | ~1 GB | ~32x |

| base | 74 M | base.en | base | ~1 GB | ~16x |

| small | 244 M | small.en | small | ~2 GB | ~6x |

| medium | 769 M | medium.en | medium | ~5 GB | ~2x |

| large | 1550 M | N/A | large | ~10 GB | 1x |

2.Whisper github开源项目

本文使用的Github开源项目为以下3个:

-

- Autotranslate

https://github.com/lewangdev/autotranslate - Immersive-translate

https://github.com/immersive-translate/immersive-translate - Whisper desktop

https://github.com/Const-me/Whisper

- Autotranslate

在使用Autotranslate开源项目时,可以在运行时提交付费且有余额的OpenAI API Key,使用ChatGPT进行翻译,其翻译效果更优。但是,API Key不同于Access Token,一方面需要付费,同时仍然存在各种限制。ChatGPT(GPT3.5)官方API模型名称为“gpt-3.5-turbo”和“gpt-3.5-turbo-0301”,不仅能翻译成中英文,任意语言都是可以翻译的。需要注意的是,API调用费用为0.002美元/1000tokens,对于英语,1个token平均是4个字符,0.75个单词;中文大概是2个token一个汉字,翻译时,问题和回复都计入tokens数量。在OpenAI官方未绑定信用卡的试用版用户,每分钟请求数最多 3 个,不具有任何使用意义。

除此之外,优秀的Whisper开源项目还有很多,包括大神基于官方开源模型开发的基于C/C++的whisper.cpp和可使用GPU加速的faster-whisper(Autotranslate就是安装、调用的faster-whisper)。

桌面GUI应用除Whisper Desktop之外,Buzz 也是一款基于 OpenAI Whisper 的开源、可离线的实时语音转文字工具,支持 Windows、macOS、Linux等多终端,它可以将麦克风的语音实时转换为文字,也支持将视频、音频文件转换为文字、字幕。

国内可用的Whisper在线联网转录应用还包括网易见外、飞书妙记、剪映、必剪等。

3.应用过程

在Autotranslate项目页面上直接点击”NOTEBOOK“按钮,可直接跳转至Google Colab Notebook页面,即可直接逐块运行。

Autotranslate指定视频URL,利用faster-whisper识别文字到word级别,按照一定规则合并为句子后再调用 ChatGPT接口进行翻译。据作者测试,实践150分钟视频转录抓取,Colab T4耗时约30分钟(也许是40分钟,忘了)。应用需要自己的OpenAI API Key,没有付费API Key的用户最后的转中文翻译语句块不用尝试,而Azure OpenAI API的申请门槛对于个人而言不低,除了信用卡,还有就是需要自备活跃的、规范的企业邮箱。

后面的Immersive-translate已经发布到了Edge加载项市场(不是win系统的Store应用市场),作为扩展插件安装即可,无需在项目首页下载release版本自行手动安装。

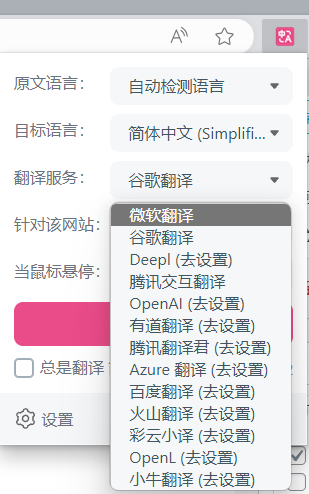

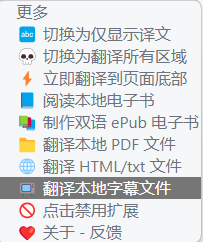

搜索"Immersive-translate",第一项就是,安装即可。将该插件显示在工具栏上,”翻译服务“指定使用的服务(OpenAI或谷歌、必应...),以及"更多"下拉列表中的翻译选项,当然,包括翻译本地字幕。

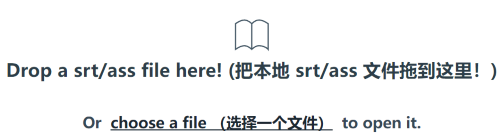

在翻译本地字幕页面,直接拖放或者导入文件即可完成本地字幕文件翻译。

4.GLLM模型下载及Whisper Desktop应用

OpenAI于2022年9月开源原始系列,2022年12月开源large-v2,可使用的large-v2模型可在huggingface.co下载:

https://huggingface.co/4bit/whisper-large-v2-ggml

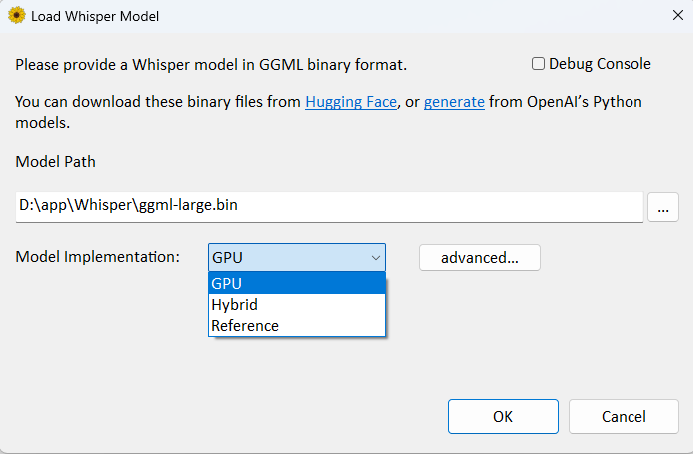

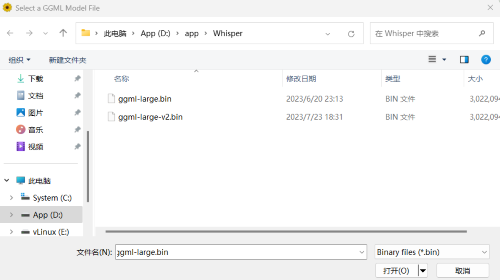

large-v2模型经过多次正则化训练,与之前的large模型相比,性能有所提高,结构与原来的大模型相同,当' load_model("large") '被调用时,"large-v2"模型将被加载。whisper desktop下载后无需安装,直接解压运行。可以选择GPU(实际只支持Nvidia GPU)。

同时,模型可以自主加载,如果没有GPU,建议使用Medium,而非本文采用的Large。

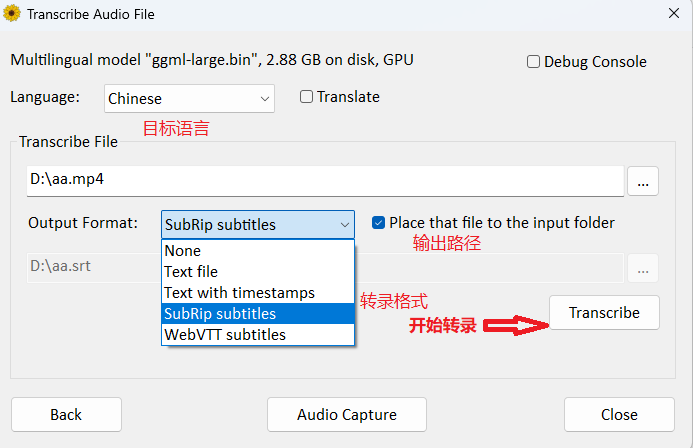

之后,在确定抓取转录的音视频文件后,确定目标语言、输出格式、输出路径的基础上即可开始进行转录抓取。如果翻译后的输出结果为繁体中文,可使用Microsoft word转换下(繁转简)。Whisper 使用--language来指定语言,但无论是简体中文还是繁体中文,对应的代码都是zh。很多情况下,使用Whisper 生成字幕文件,设置参数--language zh,会生成繁体中文的字幕文件,需要使用<--initial_prompt "以下是普通话的句子。">作为初始化prompt以确保转译输出简体中文。

5.写在最后

Whisper应用众多,常用的UI友好的Desktop应用由于无法指定初始化prompt以及调整其他参数,在一些特定语言的识别、分析方面还存在瑕疵,比如日韩语,可能会出现“幻听”现象。所以,建议使用colab或者尝试本地部署,这样可以进行精确调整。Colab在线计算转录抓取的方式,普通用户由于缺乏付费API Key,可能无法实现“一步到位”,还需要本地翻译一下,而且翻译质量上大概率不如ChatGPT,所以Azure OpenAI API还是值得试着申请一下的。由于Azure在很多收费政策上的不确定,在尝试申请Azure OpenAI API需要注意,最好不要有其他多余操作。

文章评论