12月6日,谷歌发布新一代大模型 gemini 的 demo,同时 bard 也将模型更新为 gemini pro。美国时间12月13日,Gemini API对公众开放。Google官方发布的『Where Bard with Gemini Pro is available』中继续没有中国,国内也会保持屏蔽 google,因此,国内用户要体验或使用 gemini pro,需要具备以下3项条件中的1项:

- 一个未被GFW屏蔽且不屏蔽中国用户的容器平台

- 一个VPS

- 一个梯子

从账户注册与管理、用户隐私、使用便利性、专属性、国内屏蔽与平台屏蔽等方面综合考量,VPS更值得推荐。VPS上搭建境外Gemini中转站点无需额外部署代理服务,在访问google bard等站点时则可以让VPS充当机场,无论哪种方式,都是最有效、最灵活、最简单的选项。

▍使用非官方Gemini API应用

Gemini发布不久,目前开源社区成熟的Gemini API应用并不多,快速“响应”推出的开源应用都较为简单,甚至仅支持 gemini pro 而不支持gemini pro vision。因此,值得推荐的是已有的高星项目增加了对 gemini 支持的。

前文和大家分享的 geminiprochat属于快速响应类,当前仅支持 gemini pro。

GitHub - babaohuang/GeminiProChat: Minimal web UI for GeminiPro.

本文推荐的是快速增加Gemini支持的One-api或Librechat。有关one-api和librechat的部署和应用,后续发布。

GitHub - songquanpeng/one-api: OpenAI 接口管理 & 分发系统,支持 Azure、Anthropic Claude、Google PaLM 2 & Gemini、智谱 ChatGLM、百度文心一言、讯飞星火认知、阿里通义千问、360 智脑以及腾讯混元,可用于二次分发管理 key,仅单可执行文件,已打包好 Docker 镜像,一键部署,开箱即用. OpenAI key management & redistribution system, using a single API for all LLMs, and features an English UI

GitHub - danny-avila/LibreChat: Enhanced ChatGPT Clone: Features OpenAI, GPT-4 Vision, Bing, Anthropic, OpenRouter, Google Gemini, AI model switching, message search, langchain, DALL-E-3, ChatGPT Plugins, OpenAI Functions, Secure Multi-User System, Presets, completely open-source for self-hosting. More features in development

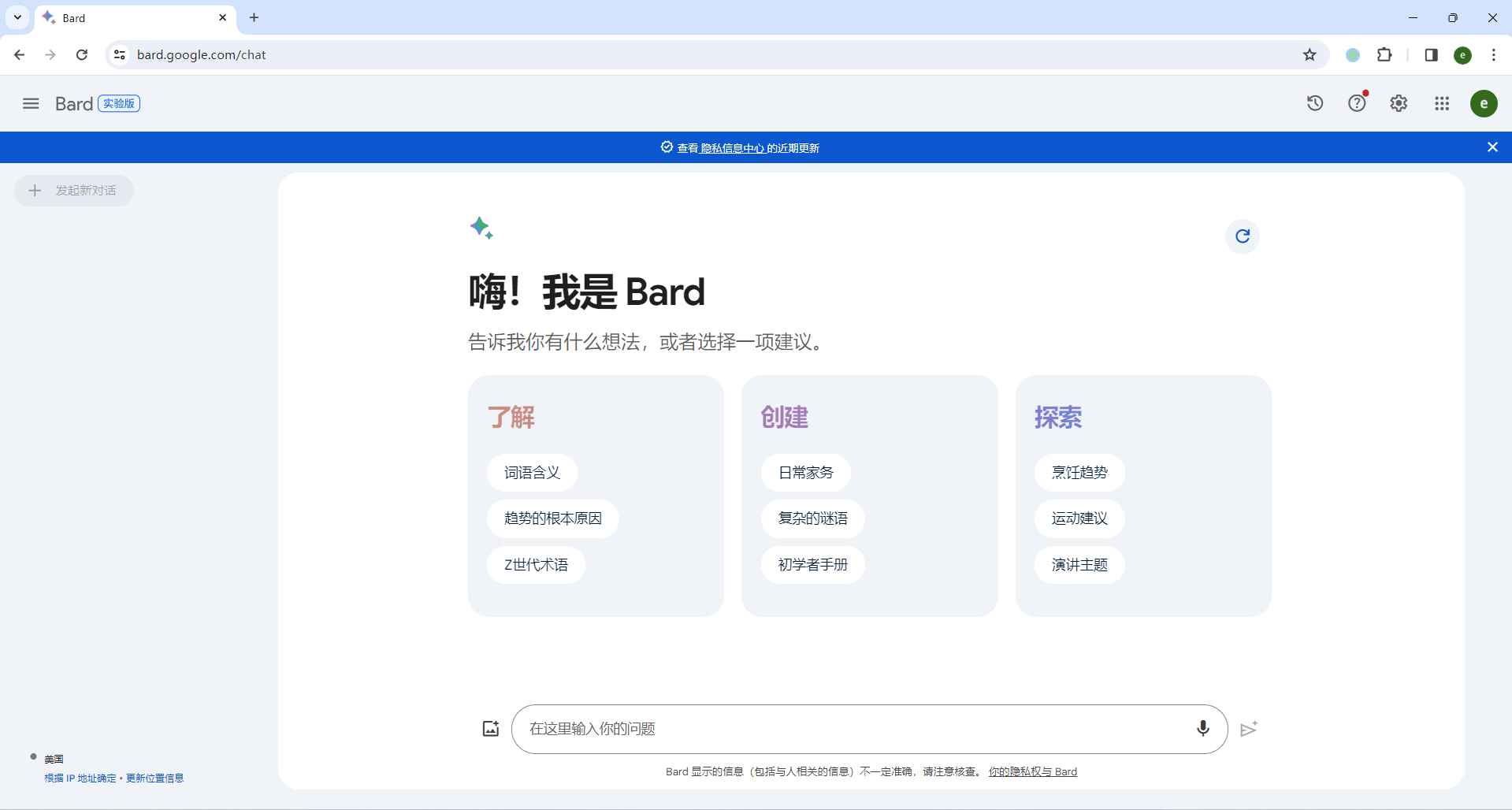

▍使用Google Bard

Bard同步更新了Gemini Pro和Gemini Pro Vision模型,通过Bard可以直接使用到Gemini Pro Vision。但存在的问题是,当前Bard的safety参数调教较为严格,导致使用Gemini Pro Vision时,图片内容有可能提示无法处理并被删除。

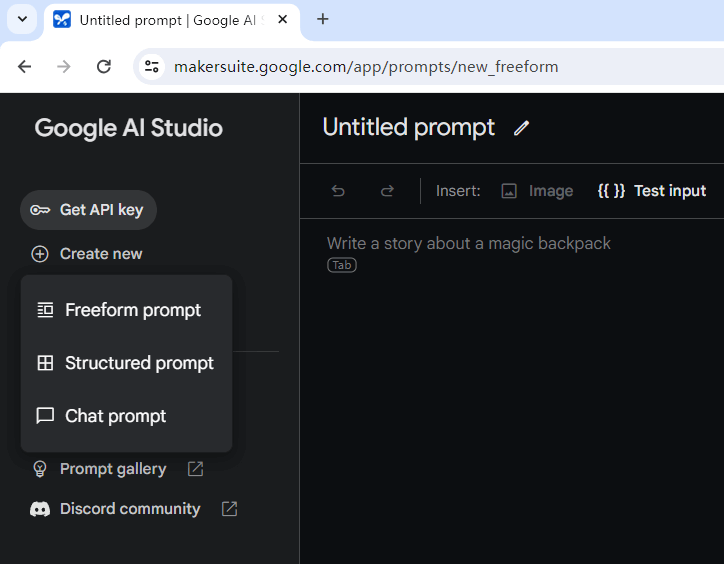

▍直接在MakerSuite/Google AI Studio中使用

MakerSuite是一个基于浏览器的 IDE,用于使用Generative language model(生成式语言模型)进行原型设计。借助 MakerSuite,可以快速试用模型并测试不同的prompt(提示)。MakerSuite支持Freeform prompt/自由格式提示、Structured prompt/结构化提示和Chat prompt/ 聊天提示。

三种Prompt的区别如下:

- Freeform prompt:提供开放式提示体验,可用于生成内容以及对说明的响应,可以同时使用图片和文本数据来提交提示;

- Structured prompt :支持表格输入,可以通过提供一组或多组示例请求和回复来指导模型输出,支持至多500组案例,当需要更好地控制模型输出的结构时,可使用此方法。

- Chat prompt:与chatgpt和bard类似的聊天对话框模式,支持输入历史会话。

打开Google AI Studio,默认采用的是Freeform prompt。Google AI Studio中,右侧的参数设定分别为:

- Model/模型选择:Gemini Pro(仅支持文字提示内容)、Gemini Pro Vision (支持图片提示内容);

- Temperature/温度:模型的创造力,越高越想象力丰富,越低越稳定;

- Add stop sequence/截断标识:匹配响应中的指定内容则截断响应输出;

- Safety settings/安全设定:可以调整对骚扰、仇恨、性、恐怖等言论的屏蔽程度;

- Output length/最大长度:响应的最大token值,默认2048;

- Top K: 输出token的方式,top 1 表示永远输出评分最高的回答,top 10 表示在前10评分的回答中取样输出一个回答;

- Top P: 输出token的方式,如果前x个回答的概率之和高于p,则Top P等价于Top K。

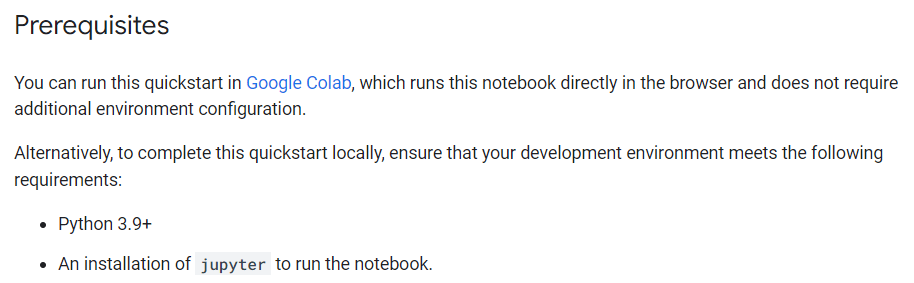

▍使用Google Colab

Google在发布Gemini的同时,也更新了相应的API文档和教程,参照「Gemini API: Quickstart with Python」一文,小白也可以快速上手通过Google Colab部署专属Gemini应用,需要的仅仅是一个Google账号。当然,除了python,还有go、node.js、web等各方面的官方指引可参考,完整覆盖了桌面和移动端。

对于习惯于使用curl的开发者,尽管官方没有在快速开始栏目中列出curl指引,但实际Google官方也有相应的笔记本指导文件可供参考。

intro_gemini_curl.ipynb - Colaboratory (google.com)

Colab上部署Gemini,分为安装与导入SDK、申请设置API Key、列出与选择模型、提交提示并获取响应、多轮对话5个步骤,官方文档已有翻译,本文不再赘述,只是该最小实现呈现的是命令行下的对话。

上述3种方法都无法解决中转问题,一方面受限于Google的支持范围,另一方面缺少可信的第三方代理。Cloudflare AI Gateway目前仅支持OpenAI、Azure以及Replicate、Hugging Face等平台,无法中转代理Gemini API访问。有关部署非官方应用Librechat和one-api的教程,后续分享。

文章评论